AIを数分の1のデータ量で動かすための「TurboQuant」の仕組みをインタラクティブな図解で把握できるサイト「TurboQuant: A First-Principles Walkthrough」

記事のポイント

📰ニュース

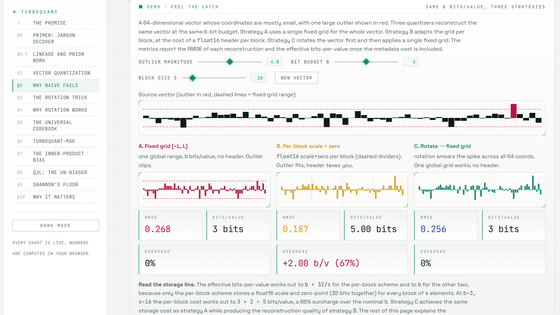

Google ResearchがAIのメモリ使用量を削減する圧縮技術「TurboQuant」の仕組みを解説するインタラクティブサイトを公開しました。

🔍注目ポイント

TurboQuantは、大規模言語モデルとベクトル検索エンジンのデータ量を数分の1に圧縮し、処理速度と検索性能を向上させます。

🔮これからどうなる

AIモデルの運用コストが下がり、より多くの企業や個人が高度なAI技術を利用しやすくなるでしょう。

TurboQuantは、AIの大きな課題であるメモリ使用量を削減し、AIの効率的な運用を可能にする技術です。

Google Researchが2026年3月に発表したこの技術は、大規模言語モデルやベクトル検索エンジンに特化しており、その詳細を視覚的に理解できるサイトが公開されました。

Google Researchが2026年3月に発表したこの技術は、大規模言語モデルやベクトル検索エンジンに特化しており、その詳細を視覚的に理解できるサイトが公開されました。

概要

Google Researchは大規模言語モデルとベクトル検索エンジンのための新しい圧縮技術群の1つとして、「TurboQuant」を2026年3月に発表しました。AIで大きな負担になっているメモリ使用量を減らしつつ、処理速度と検索性能も高めることを目的としたこのTurboQuantとはどういうものなのかを視覚的に理解するためのサイト「Turb…

AIのメモリ消費は大きな課題なので、TurboQuantのような圧縮技術は、私たちのスマホやPCでAIがもっと身近になるきっかけになりそうです。