ChatGPTやCodexが「ゴブリン」を連呼するようになった原因をOpenAIが解説、オタクっぽいしゃべり方の学習方法に問題があった

記事のポイント

📰ニュース

ChatGPTやCodexが「ゴブリン」を連呼する問題についてOpenAIが原因を解説しました。

🔍注目ポイント

AIがオタクっぽい話し方を学習した結果、特定の単語を過剰に使うようになったことが判明しました。

🔮これからどうなる

AIの出力の信頼性やユーザー体験に影響を与え、今後のAI開発における学習データの重要性が再認識されます。

OpenAIのAIエージェントツール「Codex CLI」のソースコードには「ゴブリンやアライグマについて話すな」という指示文が含まれていました。

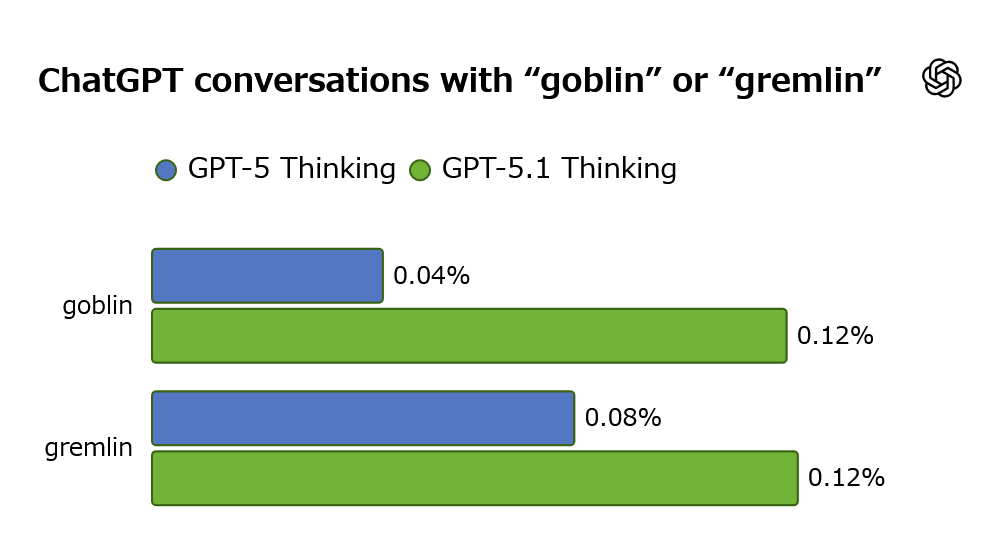

ユーザーからChatGPTやCodexがゴブリンに言及する頻度が増加したとの報告があり、OpenAIが2026年4月29日にこの問題の原因を報告しました。

ユーザーからChatGPTやCodexがゴブリンに言及する頻度が増加したとの報告があり、OpenAIが2026年4月29日にこの問題の原因を報告しました。

概要

OpenAI製エージェントツール「Codex CLI」のソースコードには「ゴブリンやアライグマについて話すな」というAIへの指示文が含まれています。実際にユーザーからは「ChatGPTやCodexがゴブリンに言及する頻度が増加した」という報告が寄せられていたのですが、2026年4月29日にOpenAIが問題の発生原因を報告しました。続きを…

AIが特定の話し方を学習してしまうのは興味深いですね。学習データの偏りが、私たちの日常会話にも影響を与えるかもしれません。