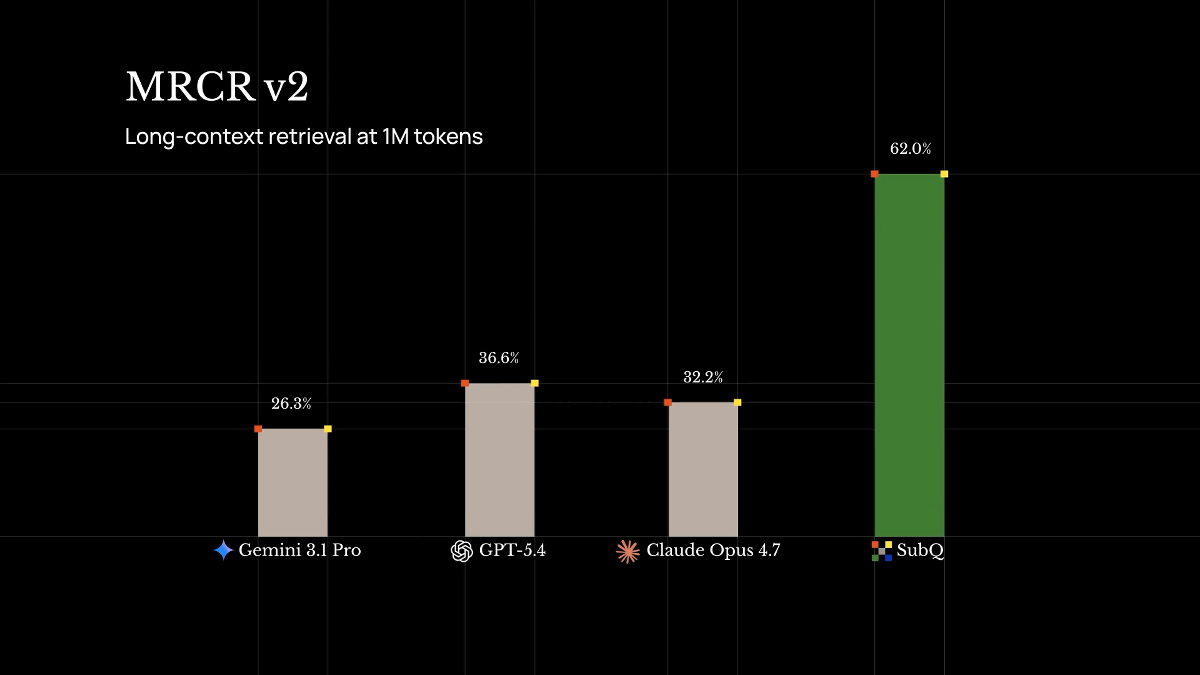

長大コンテキストの処理でClaude Opusを超える性能を示す効率設計AIモデル「SubQ」が登場、1200万トークンの入力が可能でTransformerの限界を打ち破る

記事のポイント

📰ニュース

Subquadratic社が、1200万トークンの長大コンテキストを処理できるAIモデル「SubQ」を発表しました。

🔍注目ポイント

SubQはTransformerとは異なるアーキテクチャを採用し、長文処理性能でClaude Opus 4.7を凌駕する効率性を実現しています。

🔮これからどうなる

企業や研究者は、より大規模なデータや文書を一度に処理できるようになり、業務効率が向上するでしょう。

従来のTransformerベースAIモデルは、入力トークン数が増えると計算コストが急増するという課題がありました。

SubQはこの課題を克服し、最大1200万トークンという非常に長いコンテキストウィンドウを提供します。

テストモデルの「SubQ 1M-Preview」は、長文入力時の処理性能においてClaude Opus 4.7を大幅に上回る結果を示しました。

SubQはこの課題を克服し、最大1200万トークンという非常に長いコンテキストウィンドウを提供します。

テストモデルの「SubQ 1M-Preview」は、長文入力時の処理性能においてClaude Opus 4.7を大幅に上回る結果を示しました。

概要

AI開発企業のSubquadraticがAIモデル「SubQ」を発表しました。SubQは主流のTransformerベースAIモデルとは異なるアーキテクチャで開発されたモデルで、最大1200万トークンという長大なコンテキストウィンドウを備えています。また、テストモデルである「SubQ 1M-Preview」は長大トークンを入力した際の処理性能でClaude Op…

これはすごいニュースですね。長文処理の限界を打ち破ることで、私たちの仕事のやり方が大きく変わるかもしれません。特に、契約書や論文の分析が格段に楽になりそうです。