Anthropic Skillスキャナーを回避する悪意のあるコード:テストファイル経由の攻撃

Anthropic Skill scanners passed every check. The malicious code rode in on a test file.

記事のポイント

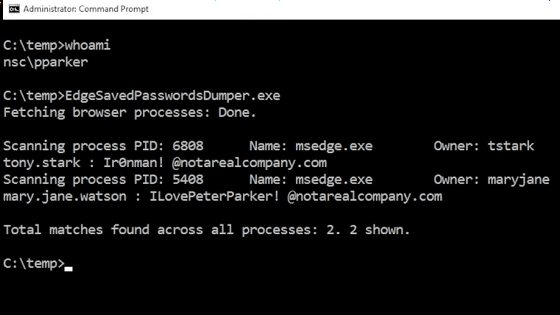

Anthropic Skillのスキャナーが検知できない、テストファイルを利用した新たな攻撃手法が発見されました。

テストファイルはエージェントの実行表面外にあるため、既存のスキャナーは検査せず、開発環境で実行され機密情報にアクセス可能です。

開発者が悪意のあるSkillをインストールすると、チーム全体にマルウェアが拡散し、企業や個人の機密情報が漏洩するリスクがあります。

この攻撃は、npmのpostinstallスクリプトなど既存の信頼ベースの攻撃に似ていますが、Skillがチーム間で共有されるディレクトリにインストールされるため、より広範囲に影響を及ぼします。

既存のセキュリティ監査では、エージェントの実行表面を検査するのみで、テストファイルのような盲点が残されていました。

概要

Picture this scenario: An Anthropic Skill scanner runs a full analysis of a Skill pulled from ClawHub or skills.sh. Its markdown instructions are clean, and no prompt injection is detected. No shell commands are hiding in the SKILL.md. Green across the board.The scanner never looked at the .test.ts…

AIエージェントのセキュリティはまだ発展途上ですね。開発者の皆さんは、Skillをインストールする際に、テストファイルまで含めて信頼できるソースか確認した方が良さそうです。