動画・音声を視聴したときの“脳反応”を予測──Metaが開発した脳活動予測AI「TRIBE v2」の可能性

記事のポイント

📰ニュース

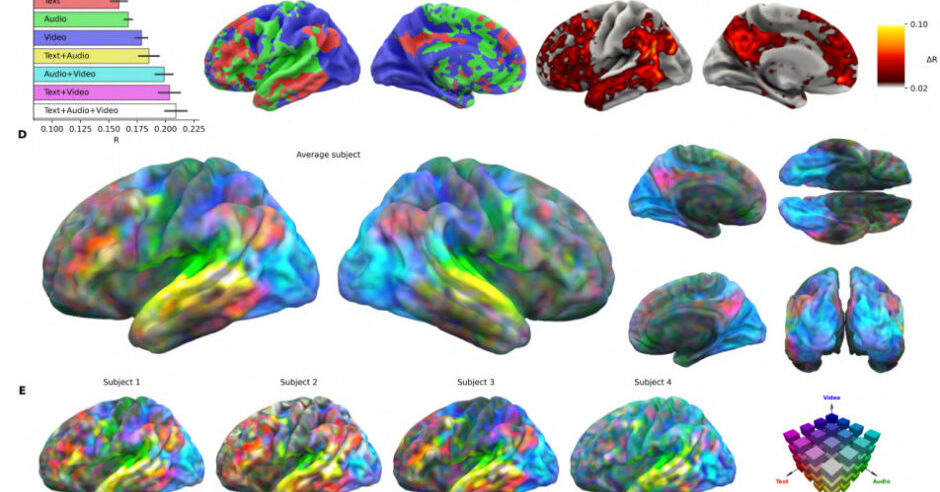

Metaの研究者らが、動画・音声を視聴した際の脳活動を予測するAI「TRIBE v2」を発表しました。

🔍注目ポイント

TRIBE v2は、視覚・聴覚・言語を統合した基盤モデルで、人間の脳反応を高精度に予測できる点が特徴です。

🔮これからどうなる

脳科学研究の効率化や、脳疾患の診断・治療法の開発に新たな可能性をもたらすことが期待されます。

この研究は、人間の脳活動をコンピュータ上でシミュレーションする「in-silico neuroscience」の進展に貢献します。

TRIBE v2は、従来の脳活動予測モデルよりも広範なデータに対応し、より詳細な脳反応の理解を可能にします。

TRIBE v2は、従来の脳活動予測モデルよりも広範なデータに対応し、より詳細な脳反応の理解を可能にします。

概要

米Metaなどに所属する研究者らが発表した論文「A foundation model of vision, audition, and language for in-silico neuroscience」は、人間の脳活動を予測する基盤モデル「TRIBE v2」を発表した研究報告だ。

脳活動を予測するAIなんて、まるでSFの世界ですね。将来、私たちの感情までAIに読み取られる日が来るかもしれません。