Meta、視覚で世界を理解する新AI「Muse Spark」発表 「Llama」より高効率でAIメガネにも統合へ

記事のポイント

📰ニュース

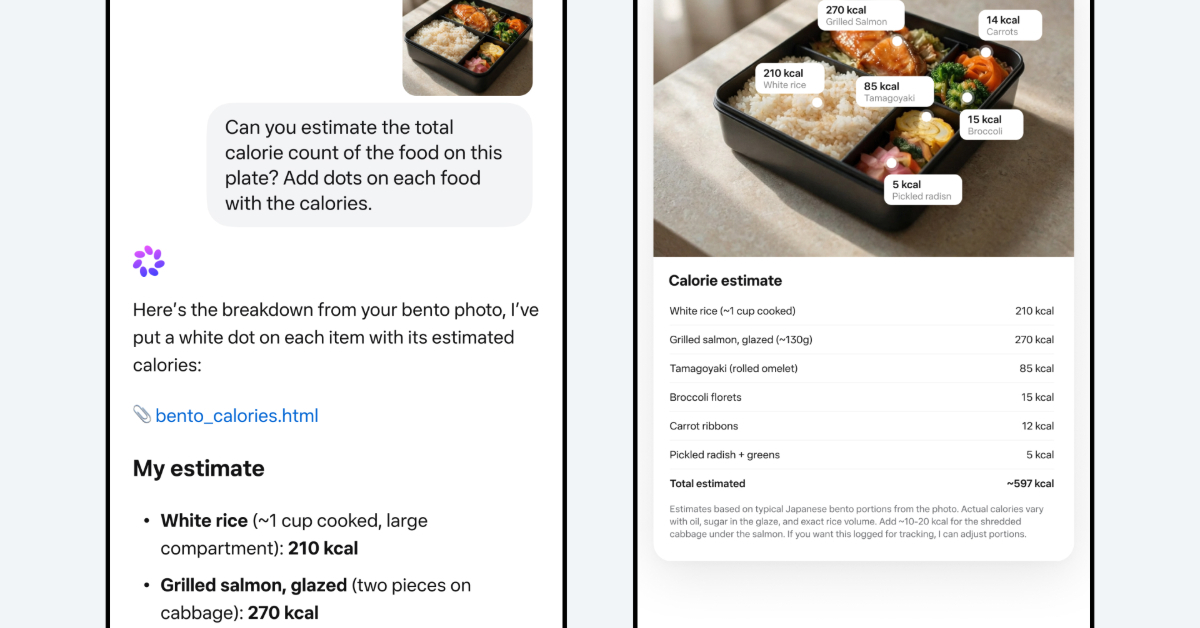

Metaが視覚理解に特化した軽量AIモデル「Muse Spark」を発表しました。

🔍注目ポイント

Llama 4 Maverickと同等の視覚認識能力をより高効率・低コストで実現する点が特徴です。

🔮これからどうなる

AIメガネへの統合により、ユーザーはより自然で高度な視覚情報に基づいたアシスタント機能を利用できるようになります。

Muse SparkはSuperintelligence Labs設立後初のAIモデルであり、医師監修の健康相談や複雑なタスクの並行処理機能も備えています。

軽量設計のため、エッジデバイスへの実装に適しており、リアルタイムでの視覚情報処理が期待されます。

軽量設計のため、エッジデバイスへの実装に適しており、リアルタイムでの視覚情報処理が期待されます。

概要

Metaは、Superintelligence Labs設立後初のAIモデル「Muse Spark」を発表した。軽量ながら視覚認識に長けたマルチモーダル推論モデルで、「Llama 4 Maverick」と同等の能力を低コストで実現する。AIメガネへの統合や、医師の監修による健康相談、複雑なタスクを並行処理する機能も備える。

Metaの新しいAIは、AIメガネに統合されることで、私たちの日常生活での情報取得やタスク実行を大きく変えるかもしれませんね。特に軽量で高性能な点が、今後のウェアラブルデバイスの進化を加速させそうです。