複数のPCからリソースをかき集めて巨大なAIモデルをローカル実行できる「mesh-llm」

記事のポイント

📰ニュース

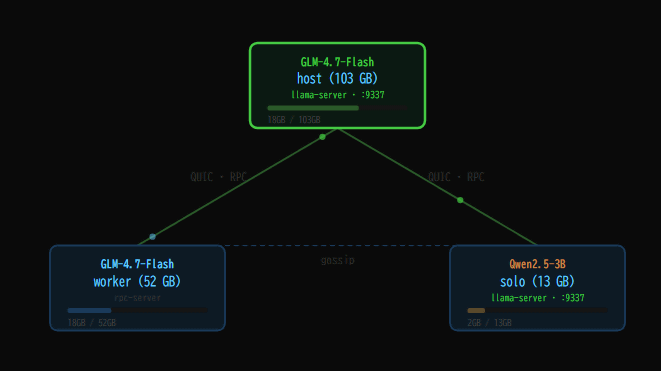

複数のPCのGPUリソースを統合し、巨大なAIモデルをローカルで実行する「mesh-llm」が登場しました。

🔍注目ポイント

複数のPCの余剰GPU資源を束ねて大規模言語モデルを分散実行でき、OpenAI互換APIで既存ツールと連携可能です。

🔮これからどうなる

個人や中小企業でも高性能なAIモデルをローカルで利用可能になり、AI開発や研究が加速するでしょう。

Mesh LLMは、一台のPCでは処理が困難な大規模言語モデルを、複数のPCのGPU計算資源を共有することで実行可能にします。

OpenAI互換APIを備えているため、既存のAIツールやエージェントから容易に利用でき、導入の敷居が低いのが特徴です。

これにより、クラウドサービスに依存せず、プライバシーを保護しながらAIモデルを運用できる可能性が広がります。

OpenAI互換APIを備えているため、既存のAIツールやエージェントから容易に利用でき、導入の敷居が低いのが特徴です。

これにより、クラウドサービスに依存せず、プライバシーを保護しながらAIモデルを運用できる可能性が広がります。

概要

Mesh LLMは、複数のコンピューターの余剰GPU計算資源を持ち寄り、1台では動かしにくい大規模言語モデルを分散実行できるようにする仕組みです。OpenAI互換APIを備えており、既存のAIツールやエージェントからそのまま使いやすい点が特徴です。続きを読む...

自宅のPCを複数繋げれば、大きなAIモデルも動かせるようになるのは、夢が広がりますね。