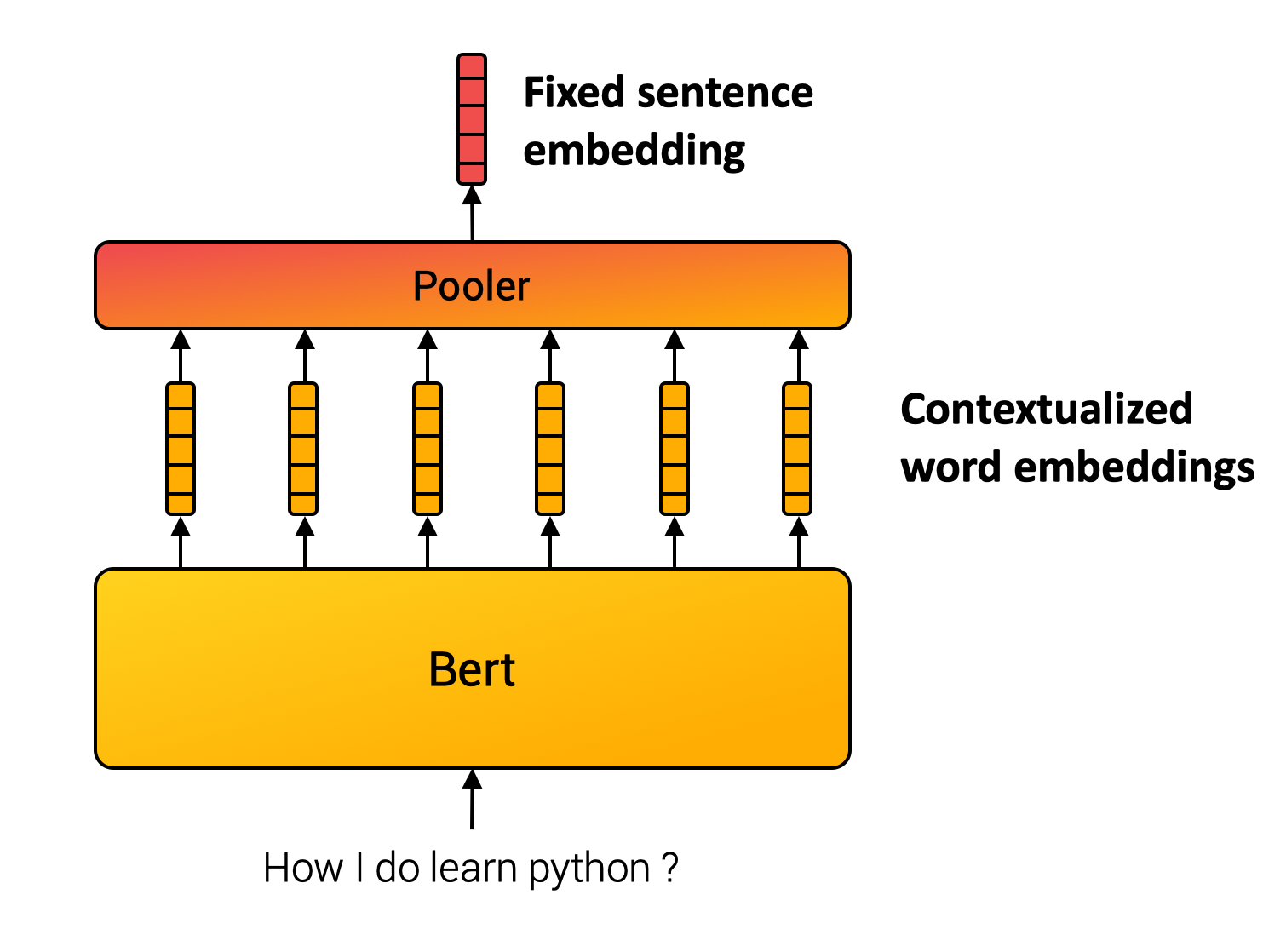

10億組の学習ペアで文章埋め込みモデルを訓練

Hugging Faceが10億組の学習ペアを用いた大規模な文章埋め込みモデルの訓練に成功しました。

AI&Tech、もう追いかけなくていい。

30秒で読めるニュースダイジェスト

Hugging Faceが10億組の学習ペアを用いた大規模な文章埋め込みモデルの訓練に成功しました。

Hugging FaceがMLOpsの新たなパラダイム「ML as Code」を提唱しました。

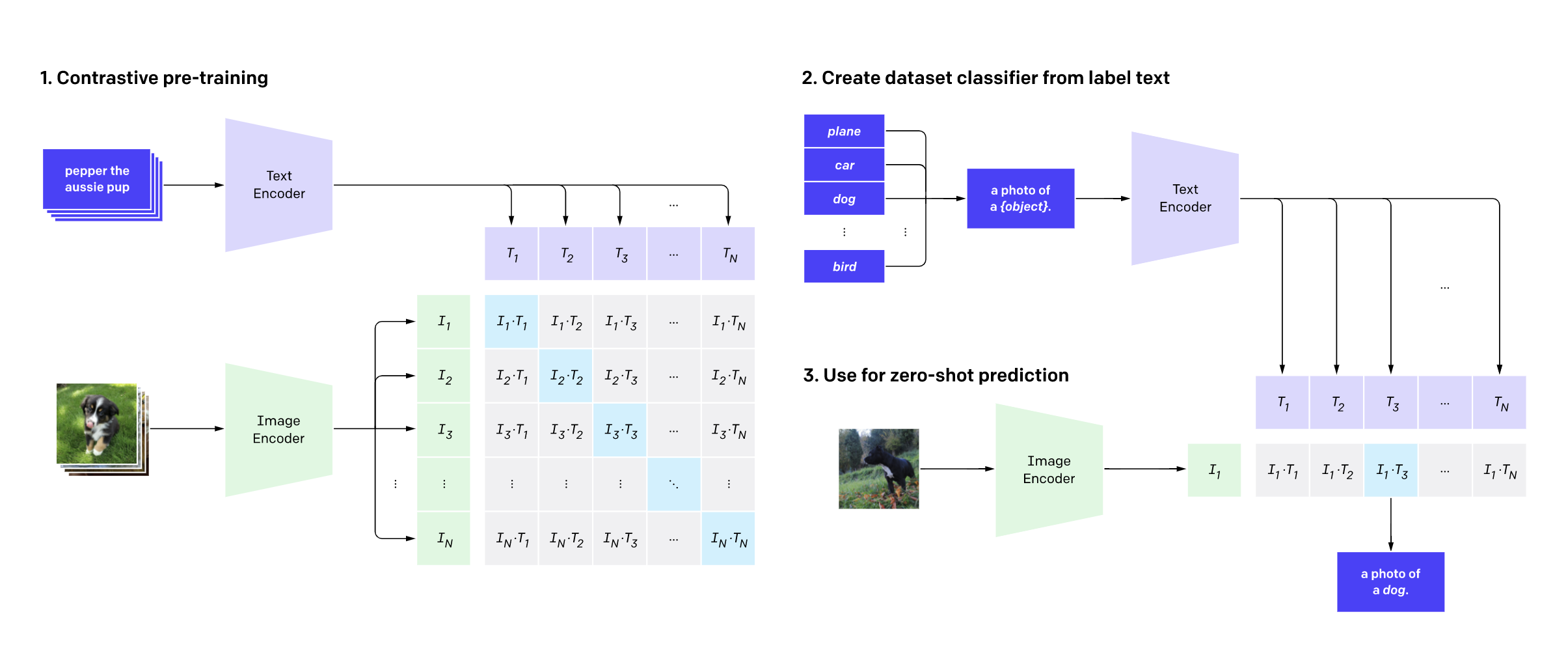

リモートセンシング画像とキャプションのデータセットでCLIPモデルがファインチューニングされました。

Hugging Face SpacesでStreamlitを活用し、モデルやデータセットを簡単にホスト・共有する方法が紹介され…

Hugging FaceがGradioを利用してSpacesでAIプロジェクトを簡単に共有できる機能を紹介しました。

Hugging Faceが夏のインターンシッププログラムの成果をブログで発表しました。

OpenAIが人間からのフィードバックを活用し、長文の書籍要約タスクでAIの性能を向上させました。

AIモデルが人間が信じている誤った情報をどれだけ真実らしく出力するかを測るベンチマーク「TruthfulQA」…

OpenAIが、CUDA経験がなくても高効率なGPUコードを書けるPythonライクな言語「Triton 1.0」をオープンソー…

インターネット上で分散されたデバイスが協力して大規模言語モデルを学習する新しいフレームワークが発表…

OpenAIがコードで訓練された大規模言語モデルの評価方法と課題について解説しています。

OpenAIが厳選された小規模データセットでファインチューニングすることで、言語モデルの特定の振る舞いを…