Anthropic、Claudeの性能低下の原因を特定し解決

Mystery solved: Anthropic reveals changes to Claude's harnesses and operating instructions likely caused degradation

記事のポイント

Anthropicが、大規模言語モデルClaudeの性能低下の原因が「ハーネス」と「操作指示」の変更にあったことを発表し、問題を解決しました。

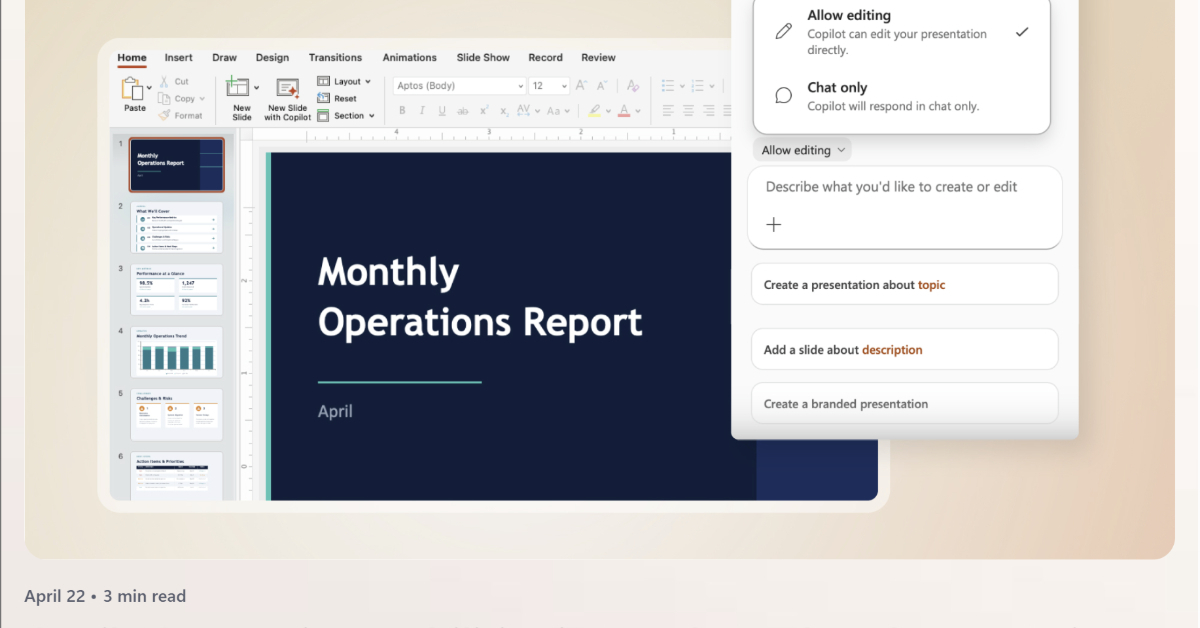

モデルの基盤となる重みではなく、UIの応答性向上を目的としたデフォルト推論努力の変更やプロンプトの調整が、意図せず性能を低下させた点が技術的ポイントです。

AI開発者やユーザーは、より信頼性の高いClaudeを利用できるようになり、AIモデルの安定性と透明性に対する信頼が向上します。

Anthropicは当初否定していましたが、詳細な技術分析やサードパーティのベンチマークにより証拠が積み重なりました。

同社は、デフォルト推論努力の変更、冗長性プロンプトの調整、キャッシュバグが原因であることを特定し、これらの問題を修正しました。

概要

For several weeks, a growing chorus of developers and AI power users claimed that Anthropic’s flagship models were losing their edge. Users across GitHub, X, and Reddit reported a phenomenon they described as "AI shrinkflation"—a perceived degradation where Claude seemed less capable of sustained r…

AIモデルの性能が、基盤だけでなく周辺の「ハーネス」によっても大きく左右されることが示されましたね。今後のAI開発では、UIとモデル性能のバランスが重要になりそうです。ユーザーの信頼回復につながるでしょう。