“説明できないAI”はもうアウト AIによる意思決定の透明性を高める「DI」とは?

記事のポイント

📰ニュース

AIによる意思決定の透明性を高める「DI」の重要性が高まっています。

🔍注目ポイント

AIの判断根拠を人間が理解できる形で説明する「説明可能なAI(XAI)」が技術的ポイントです。

🔮これからどうなる

政府機関や企業がAIを導入する際、意思決定の信頼性と説明責任を確保できるようになります。

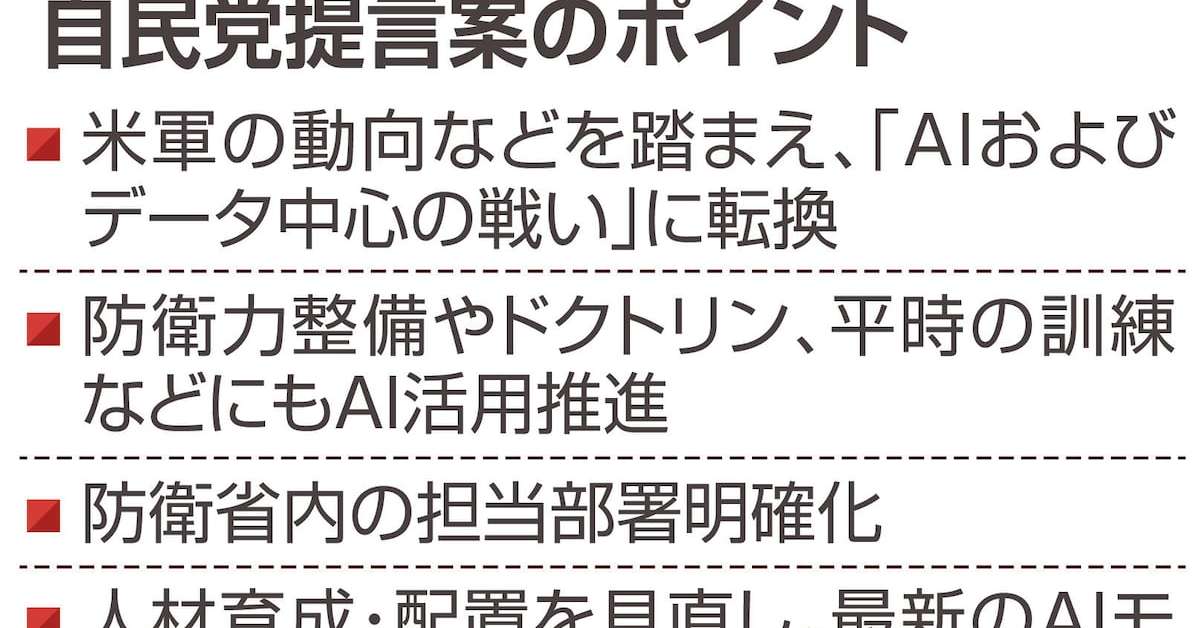

Gartnerは2028年までに政府機関の約8割がAIエージェントを導入し、意思決定を自動化すると予測しています。

これに伴い、AIの判断プロセスがブラックボックス化する問題が浮上しており、その解決策としてDI(Decision Intelligence)やXAI(Explainable AI)が注目されています。

これにより、AIがなぜその結論に至ったのかを明確にすることが求められています。

これに伴い、AIの判断プロセスがブラックボックス化する問題が浮上しており、その解決策としてDI(Decision Intelligence)やXAI(Explainable AI)が注目されています。

これにより、AIがなぜその結論に至ったのかを明確にすることが求められています。

概要

2028年までに政府機関の約8割がAIエージェントを導入し、意思決定の自動化に生かすとGartnerは予測する。そこで課題となるのが、意思決定の透明性の確保だ。その対策の鍵になる「DI」と、実現に向けた取り組みとは。

AIの活用が広がる中で、その判断が透明であることは私たちの生活に直結する重要な要素です。今後は、AIの意思決定プロセスがより明確になることで、安心してAIサービスを利用できるようになりそうです。